Endlich Jarvis! – Deinen Persönlichen KI-Assistenten selbst betreiben

Abstract

Thu 8:45 - 9:30 Uhr | 2026

Ein LLM ist beeindruckend – aber es kennt alles über die Welt und nichts über dich. Deine laufenden Projekte, deine Entscheidungen vom letzten Quartal, dein Kontext: für die KI ist das unsichtbar. Deshalb bleibt der „persönliche Assistent” trotz aller Fortschritte ein Versprechen – beeindruckend auf der Bühne, im echten Alltag kaum angekommen.

Der fehlende Baustein ist ein geteiltes Gedächtnis – und die Lösung ist verblüffend simpel: Obsidian-Markdown-Dateien. Kein komplexes Setup, keine Middleware. Der persönliche AI Agent liest dieselben Dateien, die du selbst pflegst – deine Notizen, Projekte, Entscheidungen. Du und dein Assistent arbeiten aus demselben Wissenspool. Das ist der Unterschied zwischen einem generischen Chat-Tool und einem echten persönlichen Assistenten.

Das verändert Wissensarbeit konkret: Meetings werden aus eigenen Notizen vorbereitet, Dokumente entstehen aus dem, was du bereits weißt – und dieser Vortrag selbst wurde genau so gebaut. Und natürlich: Coding-Assistenten wie GitHub Copilot, die OpenAI CLI, Google Gemini Code Assist oder Claude Code sind gute und bekannte Werkzeuge. Darum geht es hier aber nicht. Es geht um den nächsten Schritt: Agentic AI – KI, die nicht nur Code schreibt, sondern Aufgaben übernimmt, Wissen nutzt und eigenständig handelt.

Und das „selbst betreiben” im Titel ist kein Zufall. Es geht nicht nur um Technik – es geht um Kontrolle: die eigene Plattform (kein anonymer SaaS, in dem deine Gedanken verschwinden), das eigene Memory (der Vault bleibt auf deinem Rechner oder deinem Server), die eigene Modellwahl (OpenRouter, Ollama – und ja, auch europäische Modelle wie Mistral). DSGVO-konform nicht durch AGBs, sondern by design. Das ist gerade für Wissensarbeit mit persönlichem und beruflichem Kontext kein Nice-to-have, sondern eine Grundvoraussetzung.

Die Live-Demo zeigt, wohin das alles führen kann: Mit OpenClaw lässt sich dieses Wissen über einen Messenger von überall abfragen – mobil, jederzeit, mit dem vollen Kontext des eigenen Vaults im Rücken. Gesichert über eine Git-Zwischenschicht, die den Vault versioniert und kontrollierten Zugriff ermöglicht. Von hier aus sind alle Möglichkeiten offen: E-Mails, Blog-Artikel, Git-Repos, Kalender – jede Quelle, die du einbinden möchtest, erweitert das Gedächtnis deines Assistenten.

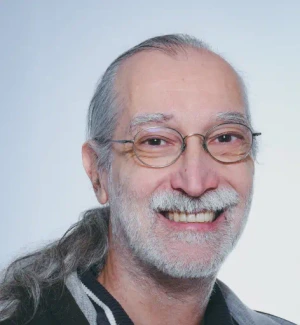

Oliver Eichler

Oliver Eichler ist seit März 2026 Senior Cloud Manager bei der DigitalNativeAlliance in Stuttgart. Als DevOps Engineer mit Schwerpunkt auf Kubernetes, AWS, Containerisierung und Systemarchitektur hat er in der Vergangenheit mit Ruby on Rails, Python und Go gearbeitet – und kennt die Herausforderungen moderner Softwareentwicklung und Infrastruktur aus der Praxis.

Was als persönliches Interesse an KI-gestütztem Wissensmanagement begann, ist längst Teil seiner täglichen Arbeit: Er integriert agentische KI-Systeme und ein „Second Brain” auf Basis von Obsidian in seine DevOps-Workflows – als produktives Werkzeug, nicht als Spielerei. Dieser Vortrag ist das direkte Ergebnis dieser Praxis: kein Konzept von der Stange, sondern gelebter Alltag.

Oliver befindet sich auf dem Weg vom klassischen Cloud Engineer zum GenAI Solution Engineer – und nimmt sein Publikum auf dieser Reise mit.